|

Бизнес

|

|

26.04.2016 ВТОРНИК 19:06

MakerBot сворачивает свое производство 3-D принтеров в Бруклине |

|

19.04.2016 ВТОРНИК 19:53

В среднем пенсионер Великобритании задолжает банкам 34 тыс. £ |

|

12.04.2016 ВТОРНИК 12:31

|

В Мире  |

Германия  |

Россия  |

Украина  |

Казахстан  |

Законы ФРГ  |

Автомобиль  |

Наука и Техника  |

Здоровье  |

Туризм и Отдых  |

Экономика и Финансы  |

Бизнес  |

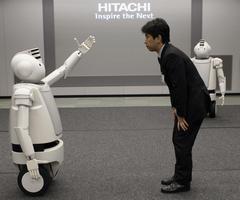

Почему роботы должны уметь говорить «нет»

Делаете ли вы все то, что вам говорят другие люди? Очевидно, что нет. Отсюда вопрос, которым задались аналитики из издания Time: должны ли будущие роботы всегда подчиняться нашим командам? На первый взгляд, кажется, что должны, потому как они бездушные машины, которые для того и созданы – выполнять наши поручения. С другой стороны – далеко не все команды должны быть исполнены.

По мнению аналитиков, существует множество гипотетических ситуаций, которые, в случае выполнения роботом поставленной задачи, могут иметь негативные последствия. При этом сами команды могут быть вполне безобидными.

По мнению аналитиков, существует множество гипотетических ситуаций, которые, в случае выполнения роботом поставленной задачи, могут иметь негативные последствия. При этом сами команды могут быть вполне безобидными.

Например, компьютеру, установленному в машине, дают команду сдать назад, когда там спит собака. Или же роботу Kitchen Aid приказывают взять в руки нож и идти вперед, прямо на шеф-повара. Команды просты, но последствия плачевны.

Как же люди могут избежать подобного? Если машина не сможет объехать вокруг собаки, то поездка, считай, невозможна в принципе. Тоже касается и второго примера. Робот либо не должен уметь ходить, либо брать предметы в руки. Однако какой тогда от него толк?

В любом случае, в этих двух случаях крайне важно определить потенциальный вред, который они могут принести при полном послушании. Если при просчитывании вариантов развития событий беды не избежать, значит, робот должен уметь сказать «нет».

Другой вопрос - как роботы могут знать, что будет дальше?

Над ответом работает профессор когнитивных и компьютерных наук из Tufts University Маттиас Шеутс. «В нашей лаборатории мы начали разрабатывать автоматизированные системы управления, которые делают простые выводы, основанные на человеческих командах. Они будут определять, следует ли роботу их выполнять в соответствии с инструкциями или отклонить их, потому что они нарушают этические принципы», - говорит ученый.

- Мы должны объяснить роботам, в каких именно ситуациях можно не повиноваться. Для этого нужно выяснить, какой вред или проблемы, могут возникнуть. Например, мяч, выброшенный в окно, не несет опасности. Однако мяч на оживленной улице – потенциальная причина для возникновения ДТП. Из этого следует, что контекст имеет значение, - продолжает Шеутс.

Помимо этого робот должен знать юридические и моральные нормы, а также нормы этикета. Созданием такой программы и занят Маттиас. Результаты его труда будут обнародованы уже в ближайшее время.

| Кирилл Ефимов |

|

Интересно почитать статьи

|

15.04.2016 ПЯТНИЦА 18:14 | ENGINEERING AND TECHNOLOGY MAGAZINE

Противостояние IT-корпораций и американского правительства продолжается. На этот раз на тропу судебной войны вышла компания Билла Гейтса. Камнем преткновения стал запрет, согласно которому Microsoft не имеет права сообщать пользователям, если их почту «прощупывает» ФБР. Подробности в статье Engineering and Technology Magazine.

НАУКА И ТЕХНИКА |

08.04.2016 ПЯТНИЦА 21:41 | TIME

Делаете ли вы все то, что вам говорят другие люди? Очевидно, что нет. Отсюда вопрос, которым задались аналитики из издания Time: должны ли будущие роботы всегда подчиняться нашим командам? На первый взгляд, кажется, что должны, потому как они бездушные машины, которые для того и созданы – выполнять наши поручения. С другой стороны – далеко не все команды должны быть исполнены.

НАУКА И ТЕХНИКА |

01.04.2016 ПЯТНИЦА 15:59 | PC WORLD

НАУКА И ТЕХНИКА Дефект в конструкции электронных дверей позволяет легко их взломать Популярные конструкции безопасных электронных дверей можно легко взломать. Об этом сообщает издание PC World. Данный процесс не требует аутентификации. В то же время он может быть активирован для всех дверных контроллеров одновременно. |

|

В Мире

|

|

25.04.2016 ПОНЕДЕЛЬНИК 19:02

«За клевету нужно нести наказание», - теннисист Рафаэль Надаль |

|

18.04.2016 ПОНЕДЕЛЬНИК 16:21

Пхеньян готовится к очередным ядерным испытаниям, - Пак Кын Хе |

|

11.04.2016 ПОНЕДЕЛЬНИК 19:50

Президент Египта подвергся критике за передачу двух островов Саудовской Аравии |

|

Германия

|

|

11.11.2015 СРЕДА 09:32

|

|

08.11.2015 ВОСКРЕСЕНЬЕ 08:47

|

|

04.11.2015 СРЕДА 09:15

|

Рекомендуемые рассылки

Рекомендуемые рассылки